Il s'agit de l'application Linux nommée PyTorch/XLA dont la dernière version peut être téléchargée sous le nom PyTorch_XLA1.13release.zip. Il peut être exécuté en ligne chez le fournisseur d'hébergement gratuit OnWorks pour les postes de travail.

Téléchargez et exécutez en ligne gratuitement cette application nommée PyTorch/XLA avec OnWorks.

Suivez ces instructions pour exécuter cette application :

- 1. Téléchargé cette application sur votre PC.

- 2. Entrez dans notre gestionnaire de fichiers https://www.onworks.net/myfiles.php?username=XXXXX avec le nom d'utilisateur que vous voulez.

- 3. Téléchargez cette application dans ce gestionnaire de fichiers.

- 4. Démarrez l'émulateur en ligne OnWorks Linux ou Windows en ligne ou l'émulateur en ligne MACOS à partir de ce site Web.

- 5. Depuis le système d'exploitation OnWorks Linux que vous venez de démarrer, accédez à notre gestionnaire de fichiers https://www.onworks.net/myfiles.php?username=XXXXX avec le nom d'utilisateur que vous souhaitez.

- 6. Téléchargez l'application, installez-la et exécutez-la.

CAPTURES D'ÉCRAN

Ad

PyTorch/XLA

DESCRIPTION

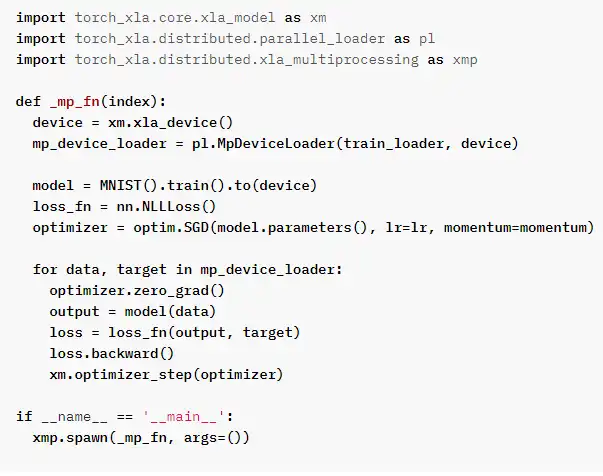

PyTorch/XLA est un package Python qui utilise le compilateur d'apprentissage en profondeur XLA pour connecter l'infrastructure d'apprentissage en profondeur PyTorch et les Cloud TPU. Vous pouvez l'essayer dès maintenant, gratuitement, sur un seul Cloud TPU avec Google Colab, et l'utiliser en production et sur des pods Cloud TPU avec Google Cloud. Jetez un œil à l'un de nos notebooks Colab pour essayer rapidement différents réseaux PyTorch exécutés sur des Cloud TPU et découvrez comment utiliser les Cloud TPU en tant qu'appareils PyTorch. Nous introduisons également de nouvelles machines virtuelles TPU pour un accès plus transparent et plus facile au matériel TPU. Il s'agit de notre méthode recommandée pour exécuter PyTorch/XLA sur Cloud TPU. Veuillez consulter notre Guide de l'utilisateur de la VM Cloud TPU. La VM Cloud TPU est actuellement en disponibilité générale et offre un accès direct à l'hôte TPU. La configuration recommandée pour l'exécution d'une formation distribuée sur des pods TPU utilise l'association de groupes d'instances de VM Compute et de pods TPU. Chacune des VM de calcul du groupe d'instances pilote 8 cœurs sur le pod TPU.

Fonctionnalités:

- PyTorch/XLA peut utiliser le type de données bfloat16 lors de l'exécution sur des TPU

- Les tenseurs XLA peuvent être déplacés du CPU vers un appareil XLA et d'un appareil XLA vers le CPU

- Une API utilitaire est fournie pour sauvegarder les données en prenant soin de les déplacer au préalable vers le CPU

- Notre CircleCI exécute des tests python natifs PyTorch pour chaque changement et chaque jour

- Utiliser des images de VM de calcul prédéfinies

- Créez votre groupe d'instances

Langage de programmation

C + +

Catégories

Il s'agit d'une application qui peut également être récupérée à partir de https://sourceforge.net/projects/pytorch-xla.mirror/. Il a été hébergé dans OnWorks afin d'être exécuté en ligne de la manière la plus simple à partir de l'un de nos systèmes d'exploitation gratuits.