This is the Linux app named FastChat whose latest release can be downloaded as Releasev0.2.30.zip. It can be run online in the free hosting provider OnWorks for workstations.

Download and run online this app named FastChat with OnWorks for free.

Follow these instructions in order to run this app:

- 1. Downloaded this application in your PC.

- 2. Enter in our file manager https://www.onworks.net/myfiles.php?username=XXXXX with the username that you want.

- 3. Upload this application in such filemanager.

- 4. Start the OnWorks Linux online or Windows online emulator or MACOS online emulator from this website.

- 5. From the OnWorks Linux OS you have just started, goto our file manager https://www.onworks.net/myfiles.php?username=XXXXX with the username that you want.

- 6. Download the application, install it and run it.

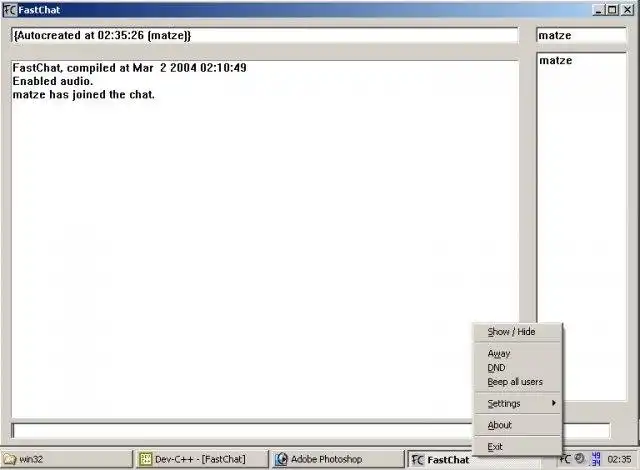

SCREENSHOTS

Ad

FastChat

DESCRIPTION

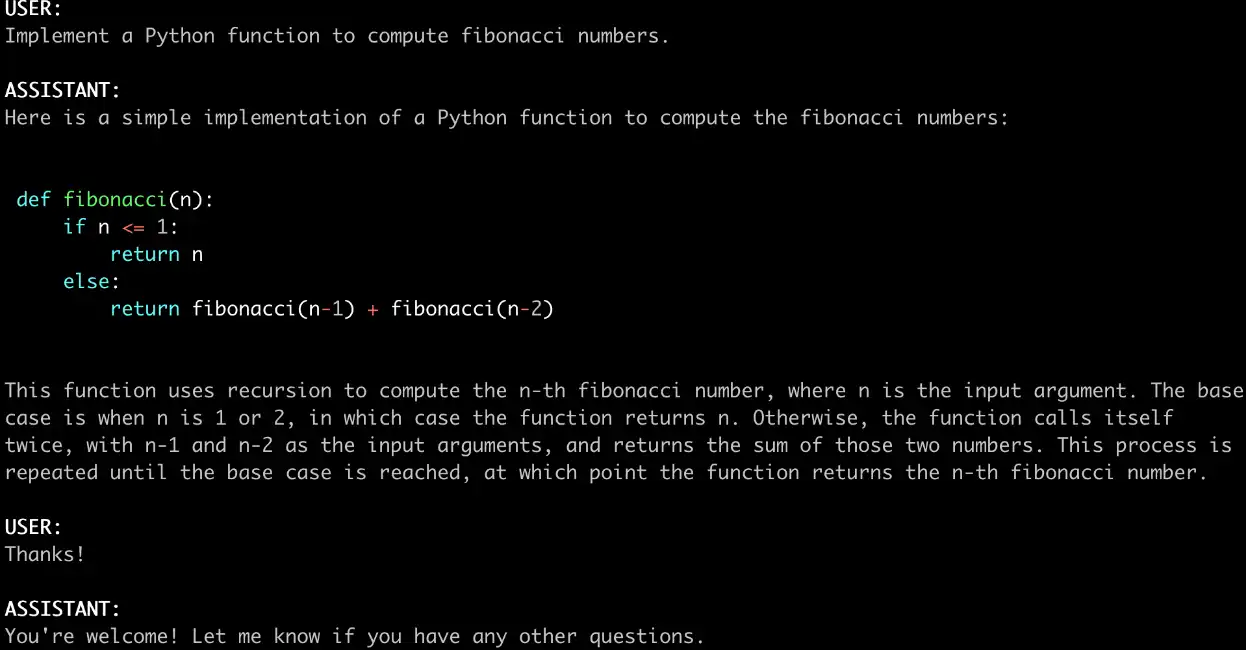

FastChat is an open platform for training, serving, and evaluating large language model-based chatbots. If you do not have enough memory, you can enable 8-bit compression by adding --load-8bit to the commands above. This can reduce memory usage by around half with slightly degraded model quality. It is compatible with the CPU, GPU, and Metal backend. Vicuna-13B with 8-bit compression can run on a single NVIDIA 3090/4080/T4/V100(16GB) GPU. In addition to that, you can add --cpu-offloading to commands above to offload weights that don't fit on your GPU onto the CPU memory. This requires 8-bit compression to be enabled and the bitsandbytes package to be installed, which is only available on linux operating systems.

Features

- The weights, training code, and evaluation code for state-of-the-art models

- A distributed multi-model serving system with Web UI and OpenAI-compatible RESTful APIs

- For training, serving, and evaluating large language models

- Reduce the CPU RAM requirement of weight conversion

- Inference with Command Line Interface

- Several supported models

Programming Language

Python

Categories

This is an application that can also be fetched from https://sourceforge.net/projects/fastchat.mirror/. It has been hosted in OnWorks in order to be run online in an easiest way from one of our free Operative Systems.