This is the Windows app named BentoML whose latest release can be downloaded as BentoML-v1.1.7sourcecode.zip. It can be run online in the free hosting provider OnWorks for workstations.

Download and run online this app named BentoML with OnWorks for free.

Follow these instructions in order to run this app:

- 1. Downloaded this application in your PC.

- 2. Enter in our file manager https://www.onworks.net/myfiles.php?username=XXXXX with the username that you want.

- 3. Upload this application in such filemanager.

- 4. Start any OS OnWorks online emulator from this website, but better Windows online emulator.

- 5. From the OnWorks Windows OS you have just started, goto our file manager https://www.onworks.net/myfiles.php?username=XXXXX with the username that you want.

- 6. Download the application and install it.

- 7. Download Wine from your Linux distributions software repositories. Once installed, you can then double-click the app to run them with Wine. You can also try PlayOnLinux, a fancy interface over Wine that will help you install popular Windows programs and games.

Wine is a way to run Windows software on Linux, but with no Windows required. Wine is an open-source Windows compatibility layer that can run Windows programs directly on any Linux desktop. Essentially, Wine is trying to re-implement enough of Windows from scratch so that it can run all those Windows applications without actually needing Windows.

SCREENSHOTS

Ad

BentoML

DESCRIPTION

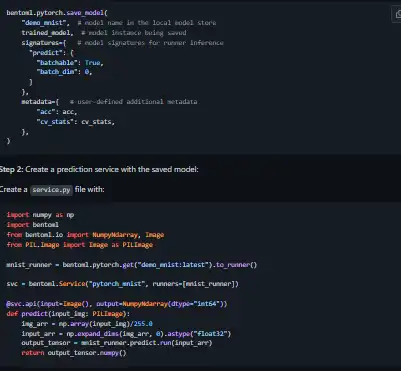

BentoML simplifies ML model deployment and serves your models at a production scale. Support multiple ML frameworks natively: Tensorflow, PyTorch, XGBoost, Scikit-Learn and many more! Define custom serving pipeline with pre-processing, post-processing and ensemble models. Standard .bento format for packaging code, models and dependencies for easy versioning and deployment. Integrate with any training pipeline or ML experimentation platform. Parallelize compute-intense model inference workloads to scale separately from the serving logic. Adaptive batching dynamically groups inference requests for optimal performance. Orchestrate distributed inference graph with multiple models via Yatai on Kubernetes. Easily configure CUDA dependencies for running inference with GPU. Automatically generate docker images for production deployment.

Features

- Online serving via REST API or gRPC

- Offline scoring on batch datasets with Apache Spark, or Dask

- Stream serving with Kafka, Beam, and Flink

- Automatically generate docker images for production deployment

- Model Deployment at scale on Kubernetes

- Fast model deployment on any cloud platform

Programming Language

Python

Categories

This is an application that can also be fetched from https://sourceforge.net/projects/bentoml.mirror/. It has been hosted in OnWorks in order to be run online in an easiest way from one of our free Operative Systems.