This is the Linux app named Petals whose latest release can be downloaded as v2.2.0_Falcon,macOSsupport,andmore.zip. It can be run online in the free hosting provider OnWorks for workstations.

Download and run online this app named Petals with OnWorks for free.

Follow these instructions in order to run this app:

- 1. Downloaded this application in your PC.

- 2. Enter in our file manager https://www.onworks.net/myfiles.php?username=XXXXX with the username that you want.

- 3. Upload this application in such filemanager.

- 4. Start the OnWorks Linux online or Windows online emulator or MACOS online emulator from this website.

- 5. From the OnWorks Linux OS you have just started, goto our file manager https://www.onworks.net/myfiles.php?username=XXXXX with the username that you want.

- 6. Download the application, install it and run it.

SCREENSHOTS

Ad

Petals

DESCRIPTION

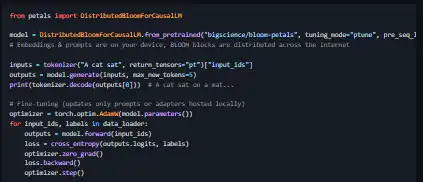

Run 100B+ language models at home, BitTorrent‑style. Run large language models like BLOOM-176B collaboratively — you load a small part of the model, then team up with people serving the other parts to run inference or fine-tuning. Single-batch inference runs at ≈ 1 sec per step (token) — up to 10x faster than offloading, enough for chatbots and other interactive apps. Parallel inference reaches hundreds of tokens/sec. Beyond classic language model APIs — you can employ any fine-tuning and sampling methods, execute custom paths through the model, or see its hidden states. You get the comforts of an API with the flexibility of PyTorch. You can also host BLOOMZ, a version of BLOOM fine-tuned to follow human instructions in the zero-shot regime — just replace bloom-petals with bloomz-petals. Petals runs large language models like BLOOM-176B collaboratively — you load a small part of the model, then team up with people serving the other parts to run inference or fine-tuning.

Features

- Petals runs large language models like BLOOM-176B collaboratively

- Single-batch inference runs at ≈ 1 sec per step (token)

- Beyond classic language model APIs

- You can employ any fine-tuning and sampling method

- You get the comforts of an API with the flexibility of PyTorch

- Parallel inference reaches hundreds of tokens/sec

Programming Language

Python

Categories

This is an application that can also be fetched from https://sourceforge.net/projects/petals.mirror/. It has been hosted in OnWorks in order to be run online in an easiest way from one of our free Operative Systems.